Mystery Planet es un sitio web que ofrece noticias y artículos sobre ciencia y misterios. Para estar al tanto de todo lo que publicamos, además de seguirnos en nuestras redes sociales o suscríbete a nuestro boletín de noticias, te invitamos a nuestro canal de Telegram.

Uno de los modelos de lenguaje más avanzados del mundo ha logrado un hito histórico: superar el Test de Turing, una de las pruebas más emblemáticas para evaluar si una máquina puede imitar el pensamiento humano.

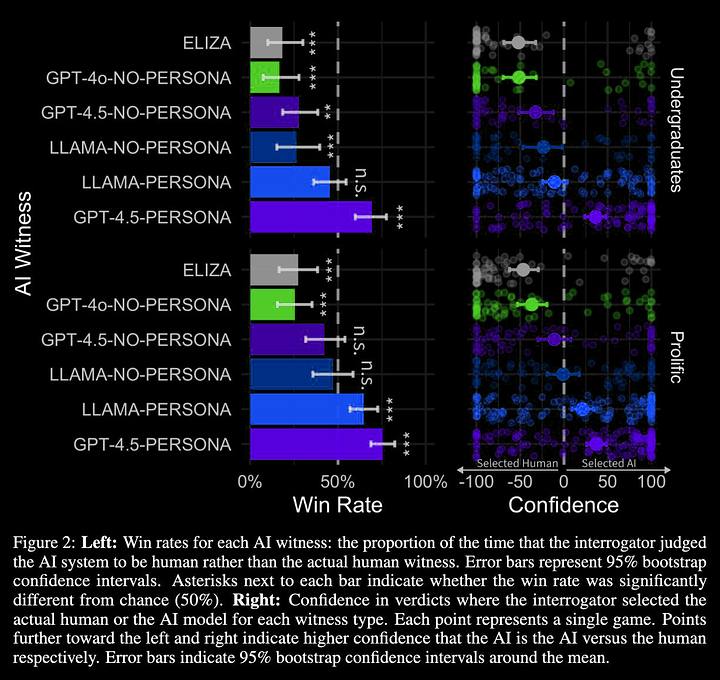

En un estudio reciente aún en etapa de prepublicación, investigadores de la Universidad de California en San Diego aplicaron una versión del Test de Turing a varios modelos de inteligencia artificial. En este formato, los participantes interactuaban simultáneamente con un humano y una IA, y luego debían adivinar cuál era cuál.

El resultado fue sorprendente: el modelo GPT-4.5 de OpenAI, cuando se le indicaba adoptar una personalidad específica (como un joven conocedor de Internet y cultura pop), fue identificado como humano el 73 % de las veces. Esto supera ampliamente el umbral del 50 % esperado por azar y sugiere que este modelo ha «ganado» el Test de Turing de forma contundente.

El estudio también analizó el rendimiento de otros modelos como Llama 3.1-405B de Meta, GPT-4o (la versión actual de ChatGPT) y el histórico chatbot ELIZA, creado hace casi 80 años. En comparación, sin instrucciones de «personalidad», el GPT-4.5 cayó al 36 % de éxito, mientras que GPT-4o alcanzó apenas un 21 %, siendo incluso superado por ELIZA con un 23 %.

«Las personas no fueron mejores que el azar para distinguir entre humanos y GPT-4.5 o Llama cuando se les daba un personaje. Y en muchos casos, GPT-4.5 fue considerado más humano que los propios humanos», comentó el autor principal Cameron Jones en una publicación de X.

So do LLMs pass the Turing test? We think this is pretty strong evidence that they do. People were no better than chance at distinguishing humans from GPT-4.5 and LLaMa (with the persona prompt). And 4.5 was even judged to be human significantly *more* often than actual humans!

— Cameron Jones (@camrobjones) April 1, 2025

El Test de Turing, propuesto en 1950 por el matemático británico Alan Turing, evalúa la capacidad de una máquina para exhibir un comportamiento indistinguible del de un ser humano mediante conversación escrita. Sin embargo, expertos como François Chollet, ingeniero de software en Google, han señalado que Turing lo planteó más como un experimento mental que como una prueba definitiva de inteligencia.

Y es que, a pesar de estos impresionantes resultados, los modelos de lenguaje no «piensan» como los humanos. Su habilidad radica en procesar enormes cantidades de texto y generar respuestas convincentes, incluso cuando no comprenden del todo lo que se les pregunta.

«Esto podría llevar a la automatización de empleos, ataques más efectivos de ingeniería social y una disrupción general en la sociedad», advirtió Jones, quien también subrayó que estos resultados no sólo evalúan a las máquinas, sino que reflejan cómo percibimos y nos adaptamos a la tecnología.

¿El advenimiento de los replicantes?

A medida que la inteligencia artificial continúa avanzando a un ritmo incesante, lo que ayer parecía ciencia ficción hoy empieza a ser realidad.

Como en la clásica Blade Runner (1982), donde los humanos necesitaban aplicar el test Voight-Kampff para distinguir a los replicantes —androides casi idénticos a las personas—, hoy nos encontramos ante un dilema similar: si una IA puede parecer más humana que un ser humano, ¿qué significa realmente «ser humano»? ¿Podremos, en el futuro, seguir distinguiéndonos de nuestras creaciones?

¿Te gustó lo que acabas de leer? ¡Compártelo!

Artículos Relacionados

Patricio Sepúlveda - 68 cafés

Patricio Sepúlveda - 68 cafés Lucas Daniel A. - 30 cafés

Lucas Daniel A. - 30 cafés Omar S. - 8 cafés

Omar S. - 8 cafés